Context Offloading en Ingeniería de Contexto: Potenciando la Eficiencia de los Agentes de IA

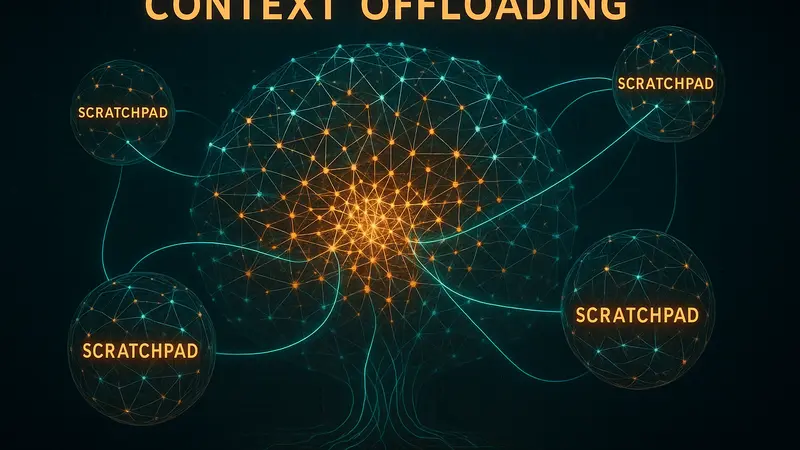

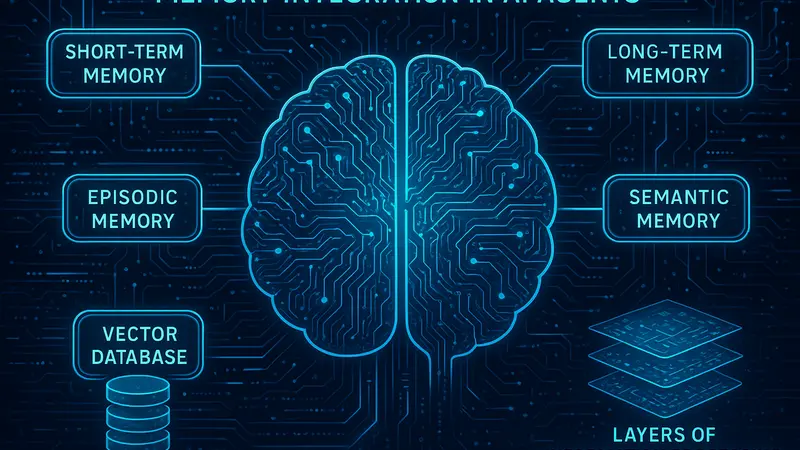

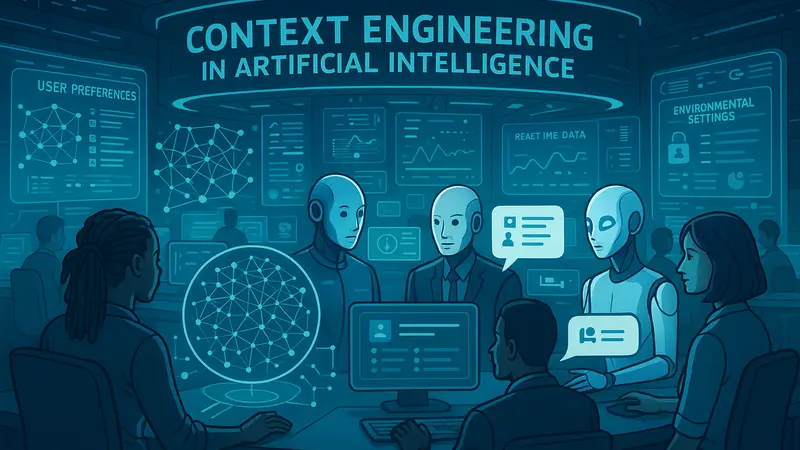

La ingeniería de contexto se ha convertido en un pilar fundamental para mejorar el rendimiento de los sistemas de inteligencia artificial, especialmente en aquellos modelos de lenguaje a gran escala. Este enfoque se centra en administrar de forma estratégica la información que se le proporciona a la IA, garantizando respuestas precisas y eficientes. Dentro de este campo, la técnica de **context offloading** destaca por su capacidad para delegar tareas secundarias y aliviar la carga cognitiva del modelo principal. En este artículo, exploraremos qué es el context offloading, sus beneficios, metodologías de implementación, desafíos y aplicaciones prácticas, respaldando la información con diversas fuentes reconocidas del sector.